Tu Cerebro Detecta Rostros Falsos en 170 Milisegundos. Por Eso Está Matando Tus Anuncios

Investigación con EEG demuestra que tu cerebro detecta rostros generados por IA antes de que seas consciente de ello. Aprende por qué esta reacción subconsciente está destruyendo tus hook rates.

Un equipo de investigación de la Universidad de Sídney mostró 50 rostros a un grupo de participantes y les pidió que identificaran cuáles eran reales y cuáles generados por IA. Los participantes acertaron el 37% de las veces, lo cual es peor que lanzar una moneda. No podían distinguirlos.

Pero sus cerebros sí.

Cuando los investigadores monitorearon la actividad neural usando EEG (electroencefalografía), los cerebros de los participantes identificaron correctamente los falsos el 54% de las veces. La brecha entre la identificación consciente y la respuesta neural subconsciente fue estadísticamente significativa. Tu cerebro sabe que algo está mal en un rostro de IA incluso cuando tú, la persona que lo mira, no tienes idea.

Para cualquiera que gaste dinero en anuncios de video, este hallazgo cambia las reglas del juego. Significa que la pregunta no es si tu audiencia puede "darse cuenta" de que tu b-roll es generado por IA. Es si su cerebro puede. Y a los 170 milisegundos, ya ha decidido antes de que su pulgar deje de hacer scroll.

Foto de Look Studio en Unsplash

Expresión humana real. Tu cerebro la procesa de manera diferente a las alternativas generadas por IA.

Foto de Look Studio en Unsplash

Expresión humana real. Tu cerebro la procesa de manera diferente a las alternativas generadas por IA.

La Señal de 170 Milisegundos

Los datos de EEG del estudio de la Universidad de Sídney identificaron exactamente cuándo la respuesta del cerebro diverge entre rostros reales y sintéticos. Según los investigadores, la actividad cerebral cambió dependiendo de si los participantes estaban mirando rostros reales o artificiales, y la diferencia se hizo notable aproximadamente 170 milisegundos después de que los rostros aparecieran en pantalla.

Ese marcador de 170ms no es arbitrario. Corresponde a una señal cerebral bien documentada llamada el N170, un componente de la respuesta eléctrica que es específicamente sensible a la disposición y el espaciado de las características faciales. Tu cerebro tiene hardware neural dedicado para leer rostros. Ha sido optimizado por millones de años de evolución. Y se activa antes de que el pensamiento consciente siquiera entre en escena.

Un estudio separado publicado en Nature's Scientific Reports confirmó este hallazgo con una metodología diferente. Los investigadores usaron potenciales evocados de estado estacionario (SSVEP) para medir cómo el cerebro responde a rostros en diferentes niveles de realismo, desde caricaturas simples hasta fotografías. Encontraron una relación no lineal, en forma de U: las imágenes más abstractas y las fotografías más realistas produjeron respuestas neurales fuertes. Pero las imágenes en el medio, la zona de "casi real pero no del todo", produjeron un patrón distintamente diferente.

La conclusión crítica: las diferencias en decodificación EEG entre rostros generados por IA y rostros humanos reales estaban presentes incluso cuando los usuarios no reportaron conscientemente esas diferencias.

Lo Que Sucede en Esos 170 Milisegundos

Para entender por qué esto importa para la publicidad, necesitas entender lo que el cerebro realmente está haciendo en esa fracción de segundo.

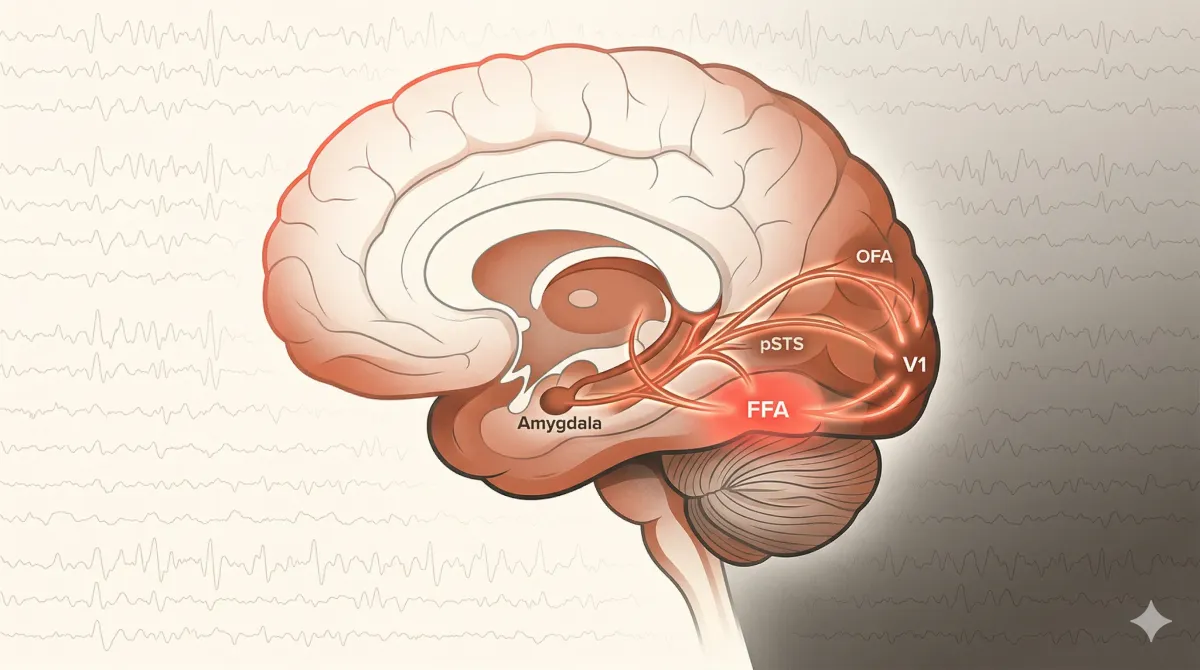

El área fusiforme facial (FFA) en la corteza occipito-temporal ventral es una región que responde con alta selectividad a los rostros. Cuando ves un rostro, el FFA se activa y comienza a procesar información configuracional: el espaciado entre los ojos, las proporciones de la nariz relativas a la boca, la simetría (o falta de simetría) de la estructura general.

Este procesamiento es automático. No eliges hacerlo. No puedes apagarlo. Y es exquisitamente sensible a la desviación de lo que un rostro humano real se ve.

Los investigadores MacDorman y Diel encontraron fuerte soporte para una teoría llamada procesamiento configuracional, la idea de que las reacciones del valle inquietante son causadas por nuestra sensibilidad al posicionamiento y tamaño de las características faciales humanas. Una teoría relacionada, el desajuste perceptual, explica la incomodidad que sentimos cuando una característica se ve realista pero otra no. Piensa: ojos realistas combinados con textura de piel sutilmente incorrecta. Esta incongruencia específica es un artefacto común en las imágenes generadas por IA.

El sistema de procesamiento facial del cerebro se activa en milisegundos, mucho antes de la conciencia.

El sistema de procesamiento facial del cerebro se activa en milisegundos, mucho antes de la conciencia.

Desde un punto de vista evolutivo, esta sensibilidad tiene sentido. Nuestros ancestros necesitaban evaluar rápidamente si un rostro mostraba señales de enfermedad. Pequeñas desviaciones de las características y movimientos faciales normales aumentan la inquietud, según investigación de Seyama y Nagayama. Incluso imperfecciones menores en personajes con apariencia humana generan incomodidad. Esto no es una peculiaridad moderna. Es un mecanismo de supervivencia.

La Conexión con el Comportamiento de Scroll

Ahora conecta esta neurociencia con lo que sucede en un feed de TikTok o Instagram.

La investigación del Digital Consumer Behaviour Report muestra que los espectadores toman aproximadamente 1.5 segundos para decidir si el contenido vale su tiempo. En esos 1.5 segundos, tu cerebro ya ha completado múltiples ciclos de ese bucle de procesamiento facial de 170ms. Ya ha formado una evaluación implícita de si el rostro en pantalla es real.

Si la evaluación regresa "algo está mal", el resultado no es un pensamiento consciente como "eso se ve generado por IA." Es un sentimiento. Una leve inquietud. Una falta de conexión. Y ese sentimiento se traduce directamente en un resultado conductual: el pulgar sigue moviéndose.

Los datos apoyan esto. En un análisis de seis marcas, SendShort encontró que los creativos con presentadores humanos y superposiciones nativas superaron a las versiones pulidas y centradas en marca en hook rate por 5 a 10 puntos. El cerebro responde más fuertemente a los rostros humanos reales, y esa respuesta se traduce en atención mediblemente más larga.

Los propios datos de Facebook confirman el efecto posterior: casi la mitad de los espectadores que permanecen por tres segundos verán durante treinta. Eso significa que si tu rostro de apertura genera incluso una respuesta sutil de valle inquietante, estás perdiendo no solo el hook sino toda la visualización.

"Pero Nadie Puede Notar que Es IA"

Esta es la objeción que escucharás de cada equipo creativo entusiasmado con las herramientas de video de IA. Y a nivel consciente, tienen parcialmente razón.

El propio estudio "Turing Reel" de Runway, publicado a principios de 2026, encontró que más del 90% de los participantes no podían distinguir confiablemente sus outputs de Gen-4.5 del video real. La precisión de detección general fue de solo 57.1%, apenas por encima del azar.

Pero profundiza en los datos. Los videos relacionados con humanos (rostros, manos, acciones) fueron significativamente más fáciles de detectar, con precisión que va del 58% al 65%. Los animales y la arquitectura realmente cayeron por debajo del azar (45-47%), lo que significa que los participantes eran más propensos a confundir metraje generado por IA con real. La brecha de detección está específicamente concentrada en el contenido humano. El tipo exacto de contenido que más importa para los hooks de anuncios.

Y recuerda el hallazgo de la Universidad de Sídney: la detección consciente y la respuesta neural subconsciente son dos cosas diferentes. Tu audiencia podría no ser capaz de decirte por qué pasaron tu anuncio con scroll. Pero su componente N170 ya tomó la decisión.

Para un análisis más profundo de las implicaciones del estudio de Runway, ver nuestro desglose en The 90% Problem: Runway's Own Study Shows Most Can't Tell, But Your Scroll Metrics Can.

1.5 segundos para decidir. Tu cerebro ya ha procesado el rostro múltiples veces en esa ventana.

1.5 segundos para decidir. Tu cerebro ya ha procesado el rostro múltiples veces en esa ventana.

La Penalización de Confianza Amplifica el Problema

El problema de detección subconsciente no existe en aislamiento. Se acumula sobre una creciente desconfianza consciente hacia el contenido de IA.

Según el Informe State of Video 2026 de Animoto, el 83% de los consumidores estadounidenses creen que pueden identificar videos generados por IA. Entre aquellos que han visto un video que sospechaban era generado por IA, el 36% dice que redujo su confianza en la marca detrás de él.

Las principales señales que los consumidores reportan: gestos robóticos (67%), voces poco naturales (55%) y falta de tono emocional (51%). Esa última es crítica. El tono emocional es exactamente lo que los clips de reacción y los hooks de b-roll necesitan transmitir para detener el scroll.

Así que enfrentas un problema dual. A nivel subconsciente, el sistema de procesamiento facial del cerebro marca el contenido como "no del todo correcto" en 170ms. A nivel consciente, un porcentaje creciente de tu audiencia está activamente buscando señales de IA. Juntos, estos crean lo que los investigadores llaman una "penalización de confianza", una reducción medible en la percepción de marca que ocurre cuando las audiencias detectan o sospechan participación de IA.

Esta es la razón principal por la que un marketplace de video construido alrededor de contenido auténtico — rostros reales, emoción real, obtenidos de creadores reales — existe como una categoría distinta del metraje de stock o la generación con IA.

El Nuremberg Institute for Market Decisions documentó esto en un estudio de 2025: simplemente etiquetar un anuncio como generado por IA hace que las personas lo vean como menos natural y menos útil, lo que reduce las actitudes hacia el anuncio y la disposición a investigar o comprar. Ni siquiera necesitas ser descubierto. La sospecha por sí sola es suficiente.

Para más sobre la penalización de confianza, lee The Trust Penalty: What Happens When Viewers Suspect Your Video Is AI.

Lo Que Esto Significa para Tu Creativo Publicitario

Las implicaciones prácticas son directas.

Tu cuadro de apertura importa más que cualquier cosa. Si tus primeros 170 milisegundos presentan un rostro generado por IA, ya has perdido un porcentaje medible de tu audiencia antes de que siquiera sean conscientes de lo que están viendo. Usa un rostro humano real con una expresión real. Un solo rostro, no un grupo. Primer plano, no plano general. El cerebro responde a los rostros individuales con más fuerza.

El hook rate es resultado del procesamiento neural. La ventaja de 5 a 10 puntos en hook rate que los presentadores humanos reales disfrutan sobre el contenido de marca pulido no es una preferencia de estilo. Es una respuesta biológica. Tu cerebro se engancha más profundamente con rostros auténticos, lo que se traduce en tiempos de visualización más largos, lo que señala calidad al algoritmo de la plataforma, lo que reduce tu CPM.

La emoción debe ser genuina. La falta de tono emocional fue citada por el 51% de los consumidores como señal de IA. Las micro-expresiones humanas reales, los movimientos diminutos alrededor de los ojos y la boca que señalan sentimiento genuino, son precisamente lo que la IA lucha por replicar y precisamente lo que el sistema de procesamiento facial del cerebro está calibrado para detectar.

Probar con clips reales es ahora una ventaja estratégica. Si tus competidores están escalando b-roll generado por IA mientras tú estás probando clips de reacción humanos auténticos, tienes una ventaja biológica que ellos no pueden cerrar con mejores prompts o modelos más nuevos. Al N170 no le importa qué tan buena sea la IA engañando a los observadores conscientes. Procesa información configuracional a un nivel por debajo de la conciencia.

Plataformas como LatinaUGC dan a las marcas acceso a una biblioteca de clips de videos de reacción genuinos de creadores latinos — con derechos comerciales de por vida — para que probar a escala no requiera contratar sesiones de grabación individuales.

Para guía táctica sobre construir hooks que detengan el scroll con rostros reales, ver The 1.5-Second Window: How Real Human Emotion Stops the Scroll.

El Argumento en Breve

La cadena de evidencia funciona así:

Tu cerebro procesa rostros a través de hardware neural dedicado que se activa a los 170 milisegundos. Este procesamiento detecta diferencias entre rostros reales y generados por IA incluso cuando no puedes identificarlos conscientemente. En un entorno de scroll, esta detección subconsciente produce una respuesta sutil de desenganche que se manifiesta como hook rates más bajos, tiempos de visualización más cortos y tasas de scroll-through más altas. Sobre esto, la desconfianza consciente del consumidor hacia el contenido de IA está creciendo, con el 36% reportando confianza de marca reducida cuando sospechan participación de IA.

Los rostros humanos reales con expresión emocional genuina evitan ambos problemas. Activan la profundidad completa del sistema de procesamiento social del cerebro. Construyen en vez de erosionar la confianza. Y entregan un rendimiento mediblemente mejor en cada métrica que importa a un media buyer.

La neurociencia no es teórica. Los datos de EEG están publicados. Los benchmarks de rendimiento están documentados. La pregunta es si tu creativo publicitario está construido sobre una base que trabaja con la biología humana o contra ella.

Creadores reales. Emoción real. Listos para probar en tu próxima campaña. Explorar la Biblioteca →

Sources

- University of Sydney, EEG deepfake detection study, reported in The Hill and Science Times, 2022

- Nature Scientific Reports, "Realness of face images can be decoded from non-linear modulation of EEG responses," 2024

- Animoto, "State of Video 2026 Report," January 2026

- Nuremberg Institute for Market Decisions, "Consumer attitudes toward AI-generated marketing content," 2025

- Runway Research, "The Turing Reel," January 2026

- SendShort, six-brand hook rate analysis, cited in Billo, 2025

- MacDorman & Diel, configural processing and uncanny valley research

- Seyama & Nagayama, facial proportions and eeriness study

- UCSD / Ayse Pinar Saygin, fMRI mismatch study

- Digital Consumer Behaviour Report, attention span data, 2025

Artículos Relacionados

- El 78% de los Consumidores Confían en Personas Reales Más que en Video de IA: Lo Que Significa el Informe 2026 de Animoto para Tus Anuncios

- El Valle Inquietante Es Real, y Está Destruyendo el Rendimiento de Tus Anuncios

- La Ventana de 1.5 Segundos: Neurociencia del Contenido que Detiene el Scroll

- Benchmarks de Hook Rate: Lo Que Significa el 30.7% Promedio y Cómo los Rostros Reales Lo Superan