Seu Cérebro Detecta Rostos Falsos em 170 Milissegundos. Veja Por Que Isso Destrói Seus Anúncios

Pesquisa com EEG prova que seu cérebro detecta rostos gerados por IA antes de você ter consciência disso. Saiba por que essa reação subconsciente está destruindo seus hook rates.

Uma equipe de pesquisa da Universidade de Sydney mostrou 50 rostos a um grupo de participantes e pediu que identificassem quais eram reais e quais eram gerados por IA. Os participantes acertaram 37% das vezes, o que é pior do que jogar uma moeda. Eles não conseguiam distinguir.

Mas seus cérebros conseguiam.

Quando os pesquisadores monitoraram a atividade neural usando EEG (eletroencefalografia), os cérebros dos participantes identificaram corretamente os falsos 54% das vezes. A diferença entre identificação consciente e resposta neural subconsciente foi estatisticamente significativa. Seu cérebro sabe que algo está errado com um rosto de IA mesmo quando você, a pessoa olhando para ele, não faz ideia.

Para qualquer pessoa investindo dinheiro em anúncios de vídeo, essa descoberta muda o jogo. Significa que a questão não é se seu público consegue "perceber" que seu b-roll é gerado por IA. É se o cérebro deles consegue. E em 170 milissegundos, ele já decidiu antes do polegar parar de rolar.

Foto de Look Studio no Unsplash

Expressão humana real. Seu cérebro a processa de forma diferente de alternativas geradas por IA.

Foto de Look Studio no Unsplash

Expressão humana real. Seu cérebro a processa de forma diferente de alternativas geradas por IA.

O Sinal de 170 Milissegundos

Os dados de EEG do estudo da Universidade de Sydney identificaram exatamente quando a resposta do cérebro diverge entre rostos reais e sintéticos. Segundo os pesquisadores, a atividade cerebral mudou dependendo de se os participantes estavam olhando para rostos reais ou artificiais, e a diferença se tornou perceptível aproximadamente 170 milissegundos após os rostos aparecerem na tela.

Esse marcador de 170ms não é arbitrário. Ele corresponde a um sinal cerebral bem documentado chamado N170, um componente da resposta elétrica que é especificamente sensível ao arranjo e espaçamento de características faciais. Seu cérebro tem hardware neural dedicado para ler rostos. Ele foi otimizado por milhões de anos de evolução. E dispara antes mesmo que o pensamento consciente entre em cena.

Um estudo separado publicado na Nature's Scientific Reports confirmou essa descoberta com uma metodologia diferente. Pesquisadores usaram potenciais evocados visuais de estado estacionário (SSVEP) para medir como o cérebro responde a rostos em diferentes níveis de realismo, de desenhos simples a fotografias. Encontraram uma relação não linear, em forma de U: as imagens mais abstratas e as fotografias mais realistas ambas produziram respostas neurais fortes. Mas imagens no meio, a zona "quase real mas não exatamente", produziram um padrão distintamente diferente.

A conclusão crítica: diferenças de decodificação EEG entre rostos gerados por IA e rostos humanos reais estavam presentes mesmo quando usuários não relataram conscientemente essas diferenças.

O Que Acontece Nesses 170 Milissegundos

Para entender por que isso importa para publicidade, você precisa entender o que o cérebro está realmente fazendo nessa fração de segundo.

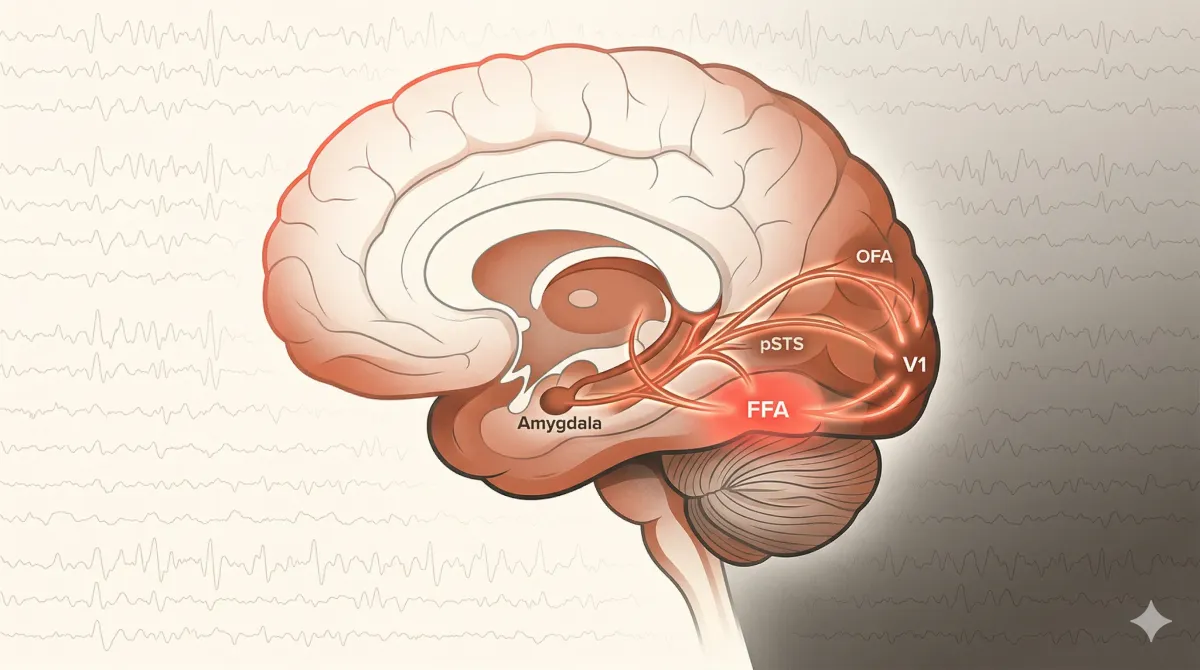

A área fusiforme de faces (FFA) no córtex occipito-temporal ventral é uma região que responde com alta seletividade a rostos. Quando você vê um rosto, a FFA ativa e começa a processar informação configuracional: o espaçamento entre os olhos, as proporções do nariz em relação à boca, a simetria (ou falta de simetria) da estrutura geral.

Esse processamento é automático. Você não escolhe fazê-lo. Você não pode desligá-lo. E ele é exquisitamente sensível a desvios do que um rosto humano real parece.

Os pesquisadores MacDorman e Diel encontraram forte suporte para uma teoria chamada processamento configuracional, a ideia de que reações do vale da estranheza são causadas por nossa sensibilidade ao posicionamento e tamanho das características faciais humanas. Uma teoria relacionada, incompatibilidade perceptual, explica o desconforto que sentimos quando uma característica parece realista mas outra não. Pense: olhos realistas combinados com textura de pele sutilmente errada. Essa incongruência específica é um artefato comum em imagens geradas por IA.

O sistema de processamento facial do cérebro ativa em milissegundos, muito antes da consciência.

O sistema de processamento facial do cérebro ativa em milissegundos, muito antes da consciência.

Do ponto de vista evolutivo, essa sensibilidade faz sentido. Nossos ancestrais precisavam avaliar rapidamente se um rosto era saudável, confiável ou ameaçador. Pequenos desvios das características e movimentos faciais normais aumentam a estranheza, segundo pesquisas de Seyama e Nagayama. Mesmo imperfeições menores em personagens humanoides disparam desconforto. Isso não é uma peculiaridade moderna. É um mecanismo de sobrevivência.

A Conexão com o Comportamento de Scroll

Agora conecte essa neurociência ao que acontece em um feed de TikTok ou Instagram.

Pesquisa do Digital Consumer Behaviour Report mostra que espectadores levam aproximadamente 1,5 segundo para decidir se o conteúdo vale seu tempo. Nesse 1,5 segundo, seu cérebro já completou múltiplos ciclos daquele loop de processamento facial de 170ms. Ele já formou uma avaliação implícita sobre se o rosto na tela é real.

Se a avaliação retorna "algo está errado", o resultado não é um pensamento consciente como "isso parece gerado por IA." É uma sensação. Um leve desconforto. Uma falta de conexão. E essa sensação se traduz diretamente em um resultado comportamental: o polegar continua se movendo.

Os dados apoiam isso. Em uma análise de seis marcas, a SendShort descobriu que criativos com apresentadores humanos e overlays nativos superaram versões polidas e pesadas de marca no hook rate em 5 a 10 pontos. O cérebro responde mais fortemente a rostos humanos reais, e essa resposta se traduz em atenção mensuravelmente mais longa.

Os próprios dados do Facebook confirmam o efeito downstream: quase metade dos espectadores que ficam por três segundos assistirão por trinta. Isso significa que se seu rosto de abertura dispara até uma resposta sutil de estranheza, você não está perdendo apenas o hook, mas a visualização inteira.

"Mas Ninguém Consegue Perceber Que É IA"

Esta é a objeção que você ouvirá de toda equipe criativa empolgada com ferramentas de vídeo de IA. E no nível consciente, eles estão parcialmente certos.

O próprio estudo "Turing Reel" da Runway, publicado no início de 2026, descobriu que mais de 90% dos participantes não conseguiam distinguir de forma confiável os outputs do Gen-4.5 de vídeo real. A precisão geral de detecção foi de apenas 57,1%, mal acima do acaso.

Mas aprofunde-se nos dados. Vídeos relacionados a humanos (rostos, mãos, ações) foram significativamente mais fáceis de detectar, com precisão variando de 58% a 65%. Animais e arquitetura ficaram abaixo do acaso (45-47%), significando que participantes tinham mais probabilidade de confundir filmagens geradas por IA com reais. A lacuna de detecção está especificamente concentrada em conteúdo humano. O tipo exato de conteúdo que mais importa para hooks de anúncios.

E lembre-se da descoberta da Universidade de Sydney: detecção consciente e resposta neural subconsciente são duas coisas diferentes. Seu público pode não ser capaz de dizer por que rolou além do seu anúncio. Mas o componente N170 deles já tomou a decisão.

Para uma análise mais profunda das implicações do estudo da Runway, veja nossa análise em O Problema dos 90%: O Próprio Estudo da Runway Mostra Que a Maioria Não Percebe, Mas Suas Métricas de Scroll Percebem.

1,5 segundo para decidir. Seu cérebro já processou o rosto múltiplas vezes nessa janela.

1,5 segundo para decidir. Seu cérebro já processou o rosto múltiplas vezes nessa janela.

A Penalidade de Confiança Agrava o Problema

O problema da detecção subconsciente não existe isoladamente. Ele se soma a uma crescente desconfiança consciente de conteúdo de IA.

Segundo o Relatório State of Video 2026 da Animoto, 83% dos consumidores dos EUA acreditam que podem identificar vídeos gerados por IA. Entre aqueles que assistiram a um vídeo que suspeitavam ser gerado por IA, 36% dizem que isso diminuiu a confiança na marca por trás dele.

Os principais indicadores que os consumidores relatam: gestos robóticos (67%), vozes não naturais (55%) e falta de tom emocional (51%). Esse último é crítico. Tom emocional é exatamente o que clipes de reação e hooks de b-roll precisam transmitir para parar o scroll.

Então você enfrenta um problema duplo. No nível subconsciente, o sistema de processamento facial do cérebro sinaliza o conteúdo como não-exatamente-certo em 170ms. No nível consciente, uma porcentagem crescente do seu público está ativamente procurando sinais de IA. Juntos, eles criam o que pesquisadores chamam de "penalidade de confiança", uma redução mensurável na percepção da marca que ocorre quando públicos detectam ou suspeitam envolvimento de IA.

Esse é o motivo central pelo qual um marketplace de vídeo construído em torno de conteúdo autêntico — rostos reais, emoções reais, sourced de criadores reais — existe como uma categoria distinta de filmagens de estoque ou geração por IA.

O Nuremberg Institute for Market Decisions documentou isso em um estudo de 2025: simplesmente rotular um anúncio como gerado por IA faz as pessoas vê-lo como menos natural e menos útil, o que diminui atitudes em relação ao anúncio e disposição para pesquisar ou comprar. Você nem precisa ser pego. A suspeita por si só é suficiente.

Para mais sobre a penalidade de confiança, leia A Penalidade de Confiança: O Que Acontece Quando Espectadores Suspeitam Que Seu Vídeo É IA.

O Que Isso Significa Para Seu Criativo Publicitário

As implicações práticas são diretas.

Seu frame de abertura importa mais do que qualquer coisa. Se seus primeiros 170 milissegundos apresentam um rosto gerado por IA, você já perdeu uma porcentagem mensurável do seu público antes de eles sequer estarem cientes do que estão assistindo. Use um rosto humano real com uma expressão real. Um rosto, não um grupo. Close-up, não plano aberto. O cérebro responde a rostos individuais mais fortemente.

Hook rate é downstream do processamento neural. A vantagem de 5 a 10 pontos no hook rate que apresentadores humanos reais possuem sobre conteúdo polido de marca não é uma preferência de estilo. É uma resposta biológica. Seu cérebro engaja mais profundamente com rostos autênticos, o que se traduz em tempos de visualização mais longos, o que sinaliza qualidade para o algoritmo da plataforma, o que reduz seu CPM.

Emoção deve ser genuína. A falta de tom emocional foi citada por 51% dos consumidores como um indicador de IA. As microexpressões humanas reais, os pequenos movimentos ao redor dos olhos e boca que sinalizam sentimento genuíno, são precisamente o que a IA luta para replicar e precisamente o que o sistema de processamento facial do cérebro está calibrado para detectar.

Testar com clipes reais agora é uma vantagem estratégica. Se seus concorrentes estão escalando b-roll gerado por IA enquanto você está testando clipes autênticos de reação humana, você tem uma vantagem biológica que eles não podem fechar com prompts melhores ou modelos mais novos. O N170 não se importa com quão boa a IA fica em enganar observadores conscientes. Ele processa informação configuracional em um nível abaixo da consciência.

Plataformas como o LatinaUGC oferecem às marcas acesso a uma biblioteca de clipes com vídeos de reação genuínos de criadores latinos — com direitos comerciais vitalícios — para que testar em escala não exija organizar filmagens individuais.

Para orientação tática sobre construir hooks que param o scroll com rostos reais, veja A Janela de 1,5 Segundo: Como Emoção Humana Real Para o Scroll.

O Argumento em Resumo

A cadeia de evidências funciona assim:

Seu cérebro processa rostos através de hardware neural dedicado que ativa em 170 milissegundos. Esse processamento detecta diferenças entre rostos reais e gerados por IA mesmo quando você não pode identificá-las conscientemente. Em um ambiente de scroll, essa detecção subconsciente produz uma resposta sutil de desengajamento que se manifesta como hook rates mais baixos, tempos de visualização mais curtos e taxas de scroll-through mais altas. Sobreposta a isso, a desconfiança consciente do consumidor em relação a conteúdo de IA está aumentando, com 36% relatando confiança reduzida na marca quando suspeitam envolvimento de IA.

Rostos humanos reais com expressão emocional genuína contornam ambos os problemas. Eles acionam toda a profundidade do sistema de processamento social do cérebro. Eles constroem em vez de corroer confiança. E entregam desempenho mensuravelmente melhor em cada métrica que importa para um media buyer.

A neurociência não é teórica. Os dados de EEG estão publicados. Os benchmarks de desempenho estão documentados. A questão é se seu criativo publicitário está construído sobre uma base que trabalha com a biologia humana ou contra ela.

Criadores reais. Emoção real. Prontos para testar na sua próxima campanha. Explore a Biblioteca →

Sources

- University of Sydney, EEG deepfake detection study, reported in The Hill and Science Times, 2022

- Nature Scientific Reports, "Realness of face images can be decoded from non-linear modulation of EEG responses," 2024

- Animoto, "State of Video 2026 Report," January 2026

- Nuremberg Institute for Market Decisions, "Consumer attitudes toward AI-generated marketing content," 2025

- Runway Research, "The Turing Reel," January 2026

- SendShort, six-brand hook rate analysis, cited in Billo, 2025

- MacDorman & Diel, configural processing and uncanny valley research

- Seyama & Nagayama, facial proportions and eeriness study

- UCSD / Ayse Pinar Saygin, fMRI mismatch study

- Digital Consumer Behaviour Report, attention span data, 2025

Artigos Relacionados

- 78% dos Consumidores Confiam em Pessoas Reais Mais do Que em Vídeo de IA: O Que o Relatório 2026 da Animoto Significa Para Seus Anúncios

- O Vale da Estranheza É Real, e Está Destruindo a Performance dos Seus Anúncios

- A Janela de 1,5 Segundo: Neurociência do Conteúdo Que Para o Scroll

- Benchmarks de Hook Rate: O Que 30,7% de Média Significa e Como Rostos Reais Superam