O Vale da Estranheza É Real, e Está Destruindo a Performance dos Seus Anúncios

O vale da estranheza não é apenas para robôs. B-roll gerado por IA aciona desconforto subconsciente que derruba seu hook rate e confiança na marca.

Em 1970, o roboticista Masahiro Mori propôs uma ideia simples: à medida que um robô se torna mais humanóide, as pessoas respondem mais positivamente a ele. Mas há uma queda. Em um certo ponto, quando o robô é quase humano mas não exatamente, a resposta emocional se torna fortemente negativa. As pessoas sentem desconforto, estranheza, até repulsa. Mori chamou essa queda de vale da estranheza.

Cinquenta e cinco anos depois, o vale da estranheza escapou do laboratório de robótica. Agora ele vive no seu feed de anúncios. Cada rosto gerado por IA, cada clipe de reação sintético, cada b-roll algoritmicamente produzido de uma "pessoa" reagindo a um produto fica bem no centro desse vale. E os dados de performance mostram isso.

Por Que o Vale Existe

O vale da estranheza não é uma falha de design ou uma preferência de gosto. É um produto de como o cérebro humano processa rostos.

Seu cérebro tem uma região dedicada ao processamento facial: a área fusiforme de faces (FFA), localizada no córtex occipito-temporal ventral. Ela responde com alta seletividade a rostos e ativa automaticamente. Você não escolhe processar um rosto. Acontece antes do pensamento consciente começar.

Quando a FFA encontra um rosto que é quase real mas levemente errado, ela cria o que pesquisadores chamam de incompatibilidade perceptual. Os olhos podem parecer realistas, mas a textura da pele não combina. As proporções faciais são próximas do normal, mas o espaçamento entre características é sutilmente errado. A expressão é tecnicamente correta, mas os micro-movimentos que acompanham emoção genuína estão ausentes.

Imagem cerebral por fMRI na UCSD confirmou como isso se sente por dentro. Pesquisadores descobriram que o cérebro "acende" de forma diferente quando aparência humanóide e movimento robótico ou sintético não combinam. O córtex parietal, especificamente as áreas conectando processamento visual com neurônios-espelho do córtex motor, mostra uma resposta de incompatibilidade. Seu cérebro está tentando prever como um rosto real deveria se mover com base em como parece, e quando a previsão falha, gera desconforto.

O sistema de processamento facial do cérebro gera desconforto quando aparência e movimento não se alinham.

O sistema de processamento facial do cérebro gera desconforto quando aparência e movimento não se alinham.

O Vale no Conteúdo Gerado por IA

O vale da estranheza foi originalmente descrito para robôs físicos. Mas uma revisão sistemática publicada na ScienceDirect confirmou que rostos virtuais são julgados como mais estranhos que rostos reais, e que essa percepção de estranheza está associada a emoções negativas e comportamentos de evitação.

Isso importa enormemente para ferramentas de vídeo de IA. A geração atual de rostos por IA melhorou dramaticamente em fidelidade visual. O Gen-4.5 da Runway produz clipes que são frequentemente indistinguíveis de filmagens reais em um olhar casual. Mas "indistinguível em um olhar casual" não é o mesmo que "processado de forma idêntica pelo cérebro."

Pesquisa da Universidade de Sydney usando EEG demonstrou que o componente N170 do cérebro, que dispara aproximadamente 170 milissegundos após ver um rosto, responde de forma diferente a rostos reais e gerados por IA. Isso acontece abaixo do nível de consciência. Participantes não conseguiam perceber a diferença. Seus cérebros conseguiam.

Uma tese do MIT investigando o vale da estranheza em imagens geradas por IA descobriu que resultados altamente realistas ou claramente estilizados levantam menos preocupações. A zona problemática é o meio: imagens que habitam o espaço "quase real". Isso mapeia diretamente ao estado atual do vídeo de IA, que é bom o suficiente para parecer real à primeira vista mas não bom o suficiente para sobreviver ao sistema automático de processamento facial do cérebro.

O Que o Vale Faz com Suas Métricas de Anúncio

O vale da estranheza não é apenas uma curiosidade. Ele produz resultados comportamentais mensuráveis que aparecem no painel do seu anúncio.

Hook rates mais baixos. Quando o sistema automático de processamento facial do cérebro sinaliza algo como não-exatamente-certo, o resultado é desengajamento sutil. O espectador não pensa "isso é IA." Simplesmente não se sente compelido a parar de rolar. Pesquisas mostram que espectadores levam aproximadamente 1,5 segundo para decidir se o conteúdo vale seu tempo. Nessa janela, o cérebro completou múltiplos ciclos de processamento facial. Se o resultado é desconforto, o polegar continua se movendo. Clipes de reação de criadores latinos reais passam em todas essas verificações, porque o rosto, a expressão e o movimento são genuinamente humanos.

Confiança reduzida. O relatório de 2026 da Animoto descobriu que 36% dos consumidores dizem que assistir a um vídeo gerado por IA diminui a confiança na marca. O vale da estranheza contribui para isso mesmo quando espectadores não conseguem articular por que se sentem desconfortáveis. Como um respondente da pesquisa descreveu, vídeos de IA têm "um visual e sensação que diz que é IA."

Menor engajamento emocional. Entre os principais indicadores que consumidores citam para vídeo de IA, 51% apontam "falta de tom emocional." O vale da estranheza especificamente interrompe a capacidade do cérebro de ler e responder à emoção. Quando você não consegue sentir o que a pessoa na tela está sentindo, o vínculo social que impulsiona engajamento se rompe.

Pior conversão downstream. Se seu hook não conecta, nada downstream funciona. Estudos mostram que criativos com apresentadores humanos superam versões polidas e pesadas de marca no hook rate em 5 a 10 pontos. Essa vantagem no hook rate se propaga: tempos de visualização mais longos levam a melhores pontuações de relevância, que levam a menor CPM, que leva a melhor ROAS.

Os Três Gatilhos

Pesquisa identifica três principais mecanismos que empurram conteúdo para o vale da estranheza. Todos os três estão presentes no vídeo atual gerado por IA.

Erros de Processamento Configuracional

Seu cérebro é exquisitamente sensível ao posicionamento e tamanho das características faciais. Os pesquisadores MacDorman e Diel descobriram que esse processamento configuracional é um dos gatilhos mais fortes de respostas do vale da estranheza. Rostos gerados por IA frequentemente têm espaçamento de características sutilmente errado, proporções que são próximas das normas humanas mas não exatamente certas. Sua mente consciente pode não notar. Sua FFA nota.

Incompatibilidade Perceptual

O desconforto se intensifica quando algumas características parecem realistas e outras não. Um rosto com olhos fotorrealistas mas pele com aparência levemente plástica. Uma boca que se move realisticamente mas olhos que não rastreiam corretamente. Seyama e Nagayama descobriram que mesmo imperfeições menores em personagens humanóides acionam desconforto, particularmente quando simetria facial e movimentos dos olhos são distorcidos.

Incoerência de Movimento

Rostos estáticos de IA melhoraram mais rápido do que movimento gerado por IA. Isso cria um problema específico para vídeo: o rosto pode parecer certo em um quadro estático, mas a forma como se move ao longo do tempo não combina com o que o cérebro espera. O estudo de fMRI da UCSD mostrou isso diretamente. O sistema de neurônios-espelho do cérebro prevê como um rosto deveria se mover com base em sua aparência. Quando o movimento não combina com a previsão, o resultado é a resposta do vale da estranheza.

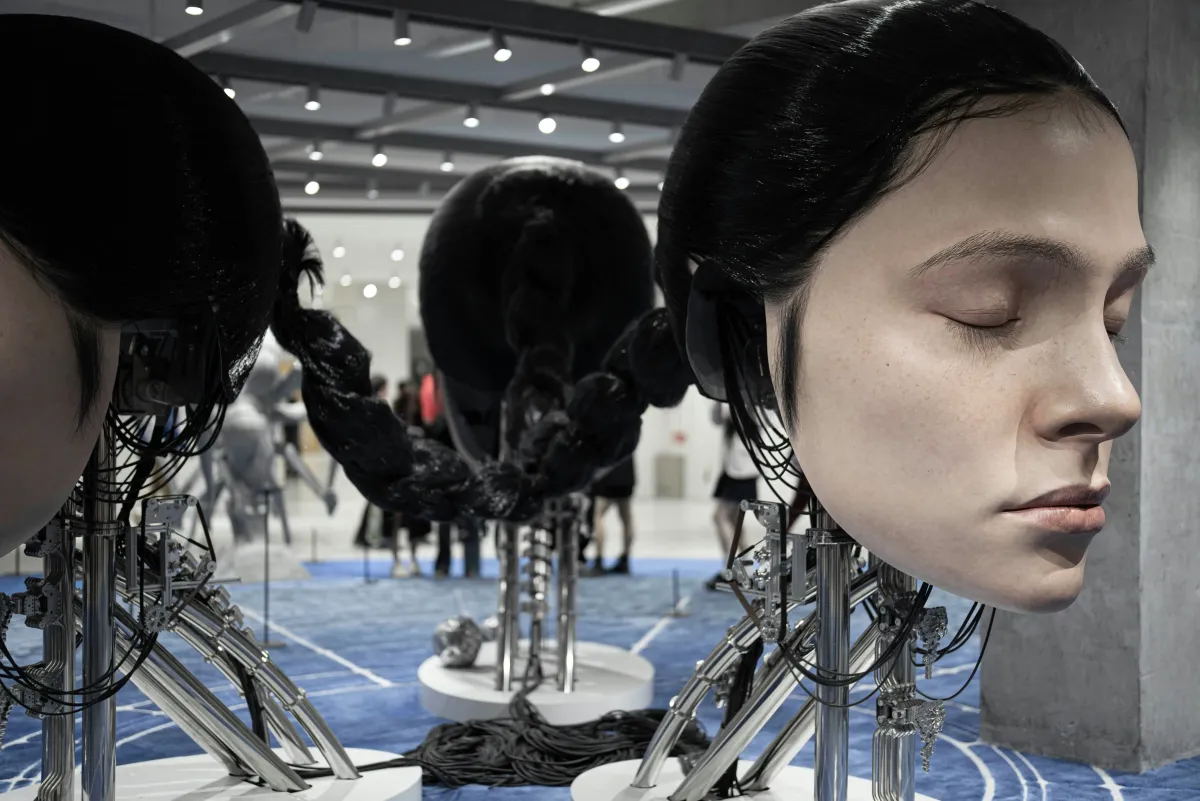

Foto de Donald Wu no Unsplash

Microexpressões genuínas são a moeda da conexão emocional. IA ainda não pode replicá-las no nível subconsciente.

Foto de Donald Wu no Unsplash

Microexpressões genuínas são a moeda da conexão emocional. IA ainda não pode replicá-las no nível subconsciente.

Por Que o Vale Não Vai Fechar Logo

A qualidade do vídeo de IA está melhorando rapidamente. Mas o vale da estranheza não é simplesmente um problema de resolução. É um problema de complexidade.

A expressão facial humana envolve o movimento coordenado de mais de 40 músculos individuais. Emoção genuína produz padrões de microexpressões, movimentos involuntários minúsculos ao redor dos olhos, boca e testa, que duram frações de segundo. Esses são os sinais que o sistema de processamento facial do cérebro é especificamente calibrado para detectar.

Modelos atuais de IA podem gerar macroexpressões plausíveis: um sorriso, um olhar de surpresa, uma carranca. O que eles lutam é com a teia complexa de microexpressões que acompanham sentimento genuíno. A leve assimetria de um sorriso real. A forma como os olhos se estreitam uma fração de segundo antes da boca se mover. A tensão involuntária na testa durante surpresa genuína versus surpresa interpretada.

Essas sutilezas são exatamente o que o N170 e a FFA são calibrados para detectar. E são exatamente o que separa um clipe de reação que para o scroll de um que é ignorado.

Trabalhando com a Biologia, Não Contra Ela

O vale da estranheza não é um bug na percepção humana. É uma funcionalidade. Evoluiu para nos proteger de ameaças que imitam aparência humana sem realmente ser humanas. Você não pode engenheirar uma solução com prompts melhores ou maior resolução.

O que você pode fazer é trabalhar com ele. Use rostos humanos reais. Use expressão emocional real. Use conteúdo onde processamento configuracional, compatibilidade perceptual e coerência de movimento todos passam na verificação, porque nunca foram artificiais em primeiro lugar.

Obter conteúdo autêntico de um marketplace de vídeo construído sobre clipes de reação gerados por usuários — em vez de gerar rostos sintéticos — significa que o problema do vale da estranheza simplesmente não surge.

Os dados de performance são consistentes: rostos reais superam os sintéticos. A neurociência explica por quê. E a implicação prática é simples: para criativos publicitários que dependem de conexão emocional, o humano não é opcional.

Para orientação tática sobre usar rostos reais para parar o scroll, veja A Janela de 1,5 Segundo: Como Emoção Humana Real Para o Scroll.

Criadores reais. Emoção real. Prontos para testar na sua próxima campanha. Explore a Biblioteca →

Sources

- Mori, M., "The Uncanny Valley," Energy journal, 1970 (translated 2012)

- UCSD / Ayse Pinar Saygin, fMRI parietal cortex mismatch study, ~2011

- ScienceDirect, "Uncanny valley effect: A qualitative synthesis of empirical research," 2023

- University of Sydney, EEG deepfake detection study, 2022

- Nature Scientific Reports, "Realness of face images decoded from EEG responses," 2024

- MIT thesis, "The Uncanny Valley: An Empirical Study on Human Perceptions of AI-Generated Text and Images," 2025

- MacDorman & Diel, configural processing and uncanny valley research

- Seyama & Nagayama, facial proportions and eeriness studies

- Animoto, "State of Video 2026 Report," January 2026

- SendShort, six-brand hook rate analysis